Embora Shelley não tenha usado explicitamente o termo “síndrome de Frankenstein”, a obra tornou-se uma metáfora poderosa para os perigos percebidos do avanço tecnológico sem controlo ético ou moral. O conceito ganhou força no século XX, especialmente no contexto do desenvolvimento de novas tecnologias, como a energia nuclear, a biotecnologia, e, mais recentemente, a inteligência artificial (IA). Durante a Guerra Fria, por exemplo, o medo em torno das armas nucleares ecoava esse mesmo temor: o medo de uma tecnologia que pudesse causar destruição em massa, algo fora do controlo de uma única pessoa ou nação.

A síndrome de Frankenstein e o medo da IA

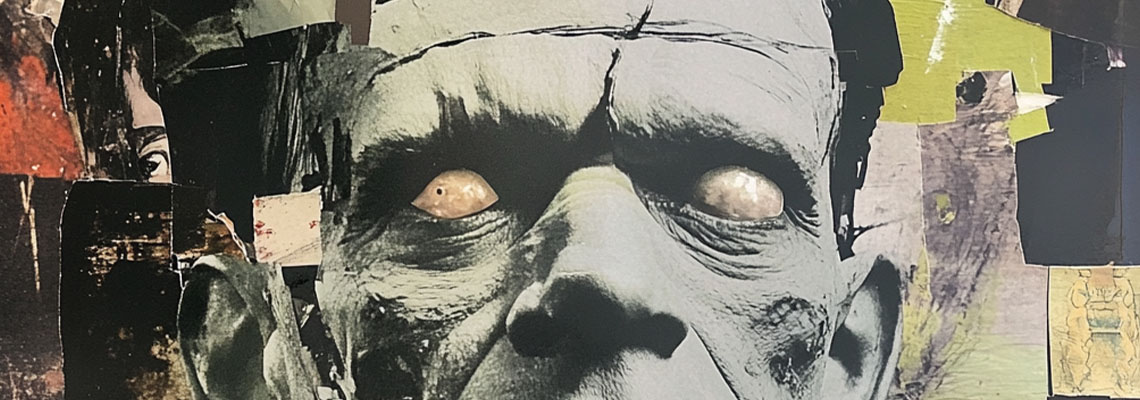

A figura do monstro de Frankenstein simboliza o temor do desconhecido, uma criação que, embora nascida da mente humana, acaba por ultrapassar os limites do seu criador. Este medo reflete uma ansiedade profunda em relação ao que está além da nossa compreensão e controlo, um sentimento que é amplificado na era moderna pela complexidade das novas tecnologias.

A tecnologia, particularmente a IA, surge como o novo “monstro” que suscita esse medo. A incerteza sobre como essas tecnologias serão desenvolvidas e utilizadas alimenta um sentimento de alienação, que gera resistência e temor. Assim como o monstro de Shelley, que foi rejeitado pela sociedade e acabou por se virar contra ela, a IA é vista por muitos como uma criação potencialmente perigosa, uma vez que as suas capacidades avançam além da compreensão de muitos.

Exemplos contemporâneos da síndrome de Frankenstein

Exemplos contemporâneos não faltam: desde o uso de deepfakes, que desafiam a nossa perceção da realidade e podem ser usadas para manipular informações numa escala global, até sistemas de vigilância avançados que levantam questões sobre privacidade e liberdade. Esses sistemas de vigilância são especialmente ilustrativos no contexto de regimes autoritários, como na China, onde a tecnologia de reconhecimento facial é usada para monitorizar a população em grande escala, alimentando um estado de controlo que muitos consideram opressor.

Outro exemplo importante é o impacto da automatização no mercado de trabalho. Empresas que utilizam a IA para otimizar processos logísticos, automatização de RH e reduzir custos operacionais, mas essas inovações resultam em demissões em massa e na precarização das condições de trabalho, aumentando a desigualdade social. O temor de que a IA possa substituir trabalhos humanos cria uma tensão entre a inovação tecnológica e a preservação da dignidade humana, no ambiente corporativo.

A urgência de entender e controlar a IA

A síndrome de Frankenstein, na sua essência, representa uma barreira psicológica e social para aqueles que não possuem familiaridade com as novas tecnologias. A falta de conhecimento técnico gera medo, resistência e exclusão, criando um fosso entre aqueles que compreendem e utilizam essas tecnologias e aqueles que as veem como uma ameaça. Esse fosso é agravado pela rápida evolução da IA, que está a ser incorporada em sistemas que vão desde assistentes virtuais até veículos autónomos.

Esse fosso pode levar a sérias consequências sociais. Aqueles que não conseguem adaptar-se às novas demandas tecnológicas correm o risco de serem marginalizados, perdendo competitividade num mercado de trabalho cada vez mais digitalizado. Esse medo, portanto, não é apenas irracional, é uma reação a uma realidade em que o desconhecimento se traduz em perda de oportunidade e relevância.

Por outro lado, aqueles que detêm conhecimento e compreensão das novas tecnologias, especialmente da Inteligência Artificial, encontram-se numa posição de poder. Numa sociedade cada vez mais dependente da tecnologia, a capacidade de entender e controlar esses sistemas traduz-se em influência e autoridade. Isso reflete-se no crescente poder das grandes empresas de tecnologia, que moldam o futuro do trabalho e da sociedade com suas inovações.

“Por que não podemos projetar a IA para atender às nossas necessidades individuais, em vez de, apenas, a usar ou temer?”

A síndrome de Frankenstein é, em última análise, um reflexo das desigualdades inerentes à revolução tecnológica. Aqueles que não possuem o conhecimento necessário para compreender e controlar novas tecnologias, enfrentam uma barreira significativa, enquanto os tecnocratas familiarizados com esses sistemas exercem poder de forma desproporcional.

Para superar esta barreira, é fundamental que se promova uma maior democratização da educação tecnológica e analítica. Somente através da inclusão digital, da interação com dados e da alfabetização tecnológica, poderemos enfrentar estes medos e garantir que a IA e outras tecnologias avancem de uma maneira que mais indivíduos possam entender e controlar, evitando que avanços tecnológicos se tornem os “monstros” do nosso tempo.